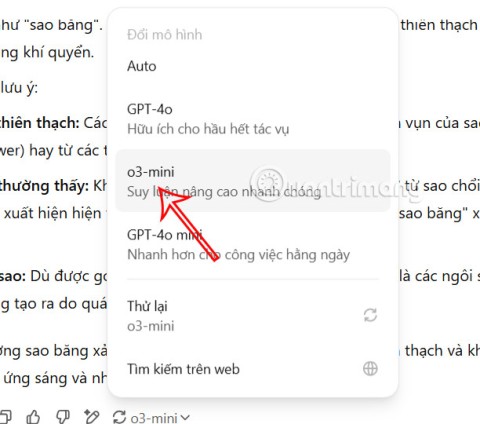

Dwa tygodnie temu dyrektor generalny OpenAI, Sam Altman, zasugerował, że o3-mini zostanie wydany „w ciągu najbliższych kilku tygodni”. Zgodnie z planem, dzisiaj OpenAI oficjalnie uruchomiło najnowszy model wnioskowania w ChatGPT i jego usłudze API. Warto zauważyć, że jest to pierwszy raz, kiedy wersja tego modelu jest udostępniana bezpłatnie użytkownikom ChatGPT, z pewnymi ograniczeniami dotyczącymi częstotliwości użytkowania.

ChatGPT o3-mini: Wyższa wydajność, szybsza prędkość

o3-mini został po raz pierwszy zaprezentowany podczas wydarzenia OpenAI „12 Days of Ship-mas” w grudniu 2024 r. Model ten został zaprojektowany tak, aby osiągnąć wydajność równą o1 w matematyce, programowaniu i nauce, ale ze znacznie szybszym czasem reakcji. Według OpenAI, o3-mini może odpowiadać o 24% szybciej niż o1-mini, a jednocześnie zapewnia większą dokładność odpowiedzi.

Szczególną cechą programu o3-mini jest to, że nie tylko podaje wynik, ale także pokazuje, jak rozwiązać problem, podobnie jak poprzedni o1-mini. Pomaga użytkownikom lepiej zrozumieć, w jaki sposób sztuczna inteligencja myśli i podaje odpowiedzi.

Firma OpenAI opublikowała także wstępne wyniki testów porównawczych, pokazujące, że o3 przewyższa o1 w przypadku wielu zadań programistycznych i analitycznych, a jednocześnie zmniejsza koszty i opóźnienia. Programiści mogą korzystać z o3-mini poprzez interfejsy API OpenAI, w tym Chat Completions API, Assistants API i Batch API.

Najważniejsze cechy o3-mini

- Szybsza reakcja: o3-mini jest o 24% szybszy niż o1-mini, co poprawia interaktywność, zwłaszcza podczas obsługi złożonych zapytań.

- Większa dokładność: Ten udoskonalony model pozwala lepiej rozwiązywać zadania matematyczne, programistyczne i naukowe. Pokazuje także, jak rozwiązywać problemy, a nie tylko podawać wyniki.

- Niższy koszt, wyższa wydajność: W porównaniu z o1-mini, o3-mini ma niższy koszt i mniejsze opóźnienia, dzięki czemu firmy i deweloperzy mają do wyboru więcej optymalnych rozwiązań.

- Bezpłatny dla użytkowników ChatGPT: Jest to pierwszy raz, kiedy OpenAI udostępniło zaawansowany model wnioskowania użytkownikom za darmo, z takimi samymi ograniczeniami częstotliwości jak GPT-4o.

- Wersja rozszerzona – o3-mini-high: Użytkownicy płacący (ChatGPT Plus, Team, Pro) mogą uzyskać dostęp do o3-mini-high, zoptymalizowanej wersji dla programistów, która pomaga pisać kod, debugować i optymalizować kod w bardziej wydajny sposób.

- Obsługa wyszukiwania w sieci: o3-mini może przeszukiwać sieć i podawać wyniki wraz z linkami źródłowymi, dzięki czemu informacje stają się bardziej wiarygodne.

- Integracja z ekosystemem Microsoft : Ten model został zintegrowany z usługą Microsoft Azure OpenAI Service, GitHub Copilot i modelami AI w serwisie GitHub, co zapewnia szerokie wsparcie dla programistów.

Płatni użytkownicy ChatGPT mogą również zdecydować się na o3-mini-high, udoskonaloną wersję z głębszymi możliwościami analizy i wnioskowania, zoptymalizowaną specjalnie pod kątem zadań programistycznych. Jednakże model ten ma dłuższy czas reakcji ze względu na złożone wymagania obliczeniowe.